由此,一次或多次超过的风险即为式建立了风险率与设计洪水频率、时间(年数)之间的关系。若在实测T年内发生了N场超标洪水Q≥Q0,则样本的似然函数为式就是计算防洪控制点洪水风险率的计算公式。......

2023-08-23

决策树有ID3,C4.5和C5.0等多种划分方法,是一种树状划分状态,在每一个节点进行条件的判断,按照一定的划分标准最终生成决策结果,其目的是为了解决机器学习中的多分类问题(方匡南等,2011),本节采用信息增益最大化(ID3法)来进行树的划分。

ID3:由增熵(Entropy)原理来决定哪个做父节点,哪个节点需要分裂。对于一组数据,熵越小说明分类结果越好(黄文,2007)。熵定义如下:

![]()

式中,p(xi)为xi出现的概率。

针对最简单的2分类问题,第一类与第二类各占一半的时候:

![]()

当只有第一类或者只有第二类时:

![]()

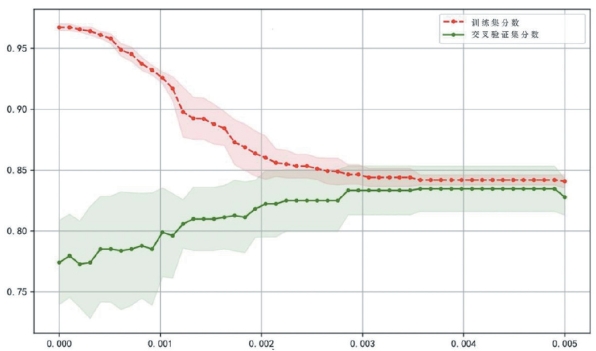

所以Entropy介于0与1之间,当值取1时,分类效果最差,熵等于0是理想状态,当值取0时,分类效果最好。依照2/8的划分准则,从768个网格中随机抽取一部分作为训练。决策树的训练集中训练得分为0.968,测试集中测试得分为0.767。随着树的深度加深,当树深为10时,在测试集中得分较高,而随着树的深度继续加深,并没有更好的提升,如图5.13所示。

图5.13 决策树调参训练过程

当节点的Gini指标小于等于某个阈值时,则表示该节点不需要进一步拆分,否则需要生成新的划分规则。利用纽约地区不同社区的属性对社区确诊人数驱动要素进行分析,最终总结出合适的规则。

有关应急大数据的空间分析与多因素关联挖掘的文章

由此,一次或多次超过的风险即为式建立了风险率与设计洪水频率、时间(年数)之间的关系。若在实测T年内发生了N场超标洪水Q≥Q0,则样本的似然函数为式就是计算防洪控制点洪水风险率的计算公式。......

2023-08-23

《食品安全法》规定,国家建立食品安全风险监测制度,对食源性疾病、食品污染以及食品中的有害因素进行监测。食品安全风险评估结果是制定、修订食品安全标准和实施食品安全监督管理的科学依据。......

2023-08-05

图4.13是VaR的概念简图。4)VaR的最大优点在于测量的综合性,可以将不同市场因子,不同市场的风险集成为一个数,较准确地测量由不同风险来源及其相互作用产生的潜在损失,较好地适应了金融市场发展的动态性、复杂性和全球化趋势。参数分析法是最常用的VaR计算方法。作为总结,表4.12比较了三种经典VaR计算方法应用于实践时的效率。表4.12 VaR计算方法比较3.VaR与可信性等级除去时间的影响,金融学上VaR的含义与M&S可信性评估定义中R的含义一致。......

2023-08-15

针对不同的威胁来源的终端安全风险图谱见图6-7。其中终端安全技术平台自身的风险,暂不列在内。与基础安全风险相比,终端安全运行风险更具动态性,随着时间和相关环境条件的变化。3)信息安全风险指终端信息安全风险为终端中存储的信息,以及信息在传递过程中所面临的风险。......

2023-11-23

考点归纳1 火灾风险评估考点应用1.火灾危险和火灾隐患有什么区别?真题解析单项选择题38建筑防火风险评估流程顺序描述正确的是( )。......

2023-08-25

所以,健康风险评估是对健康状况的判断,对未来患病和(或)死亡危险的测算,并将评估结果以量化的形式表示出来。目前,做得最多的是健康危险因素评价和生活质量评估。......

2023-12-06

图5-6-4表示最枯方案情景下2015年和2030年海水入侵风险灾害评价图。研究区中部淄河水库由于不断地补给地下水,位于其附近的低风险区面积随着时间增长而增大,到2030年增加2.5km2。中部地区淄河水库周围低风险区的范围也随着时间推移不断扩大,到2030年增加18km2,起到了河道型水库防止海水入侵的作用。......

2023-06-25

按照风险产生的原因不同,可以将企业面临的风险分为自然风险、社会风险、政治风险和经济风险。(一)自然风险自然风险是指由于自然力的不规则变化引起的种种现象导致企业财产损失的风险,如地震、火灾、风暴、洪水等。自然风险是保险人承保最多的风险。如盗窃、抢劫、罢工、玩忽职守及故意破坏等行为,可能对企业的财产或企业员工造成恶劣的影响。政治风险源于政府行为,所以又称为政府风险或国家风险。......

2023-08-11

相关推荐