社交平台正越来越成为人们接触新闻的渠道、想象世界的方式和建构价值观的来源。在散布假新闻的账户中,三分之一到三分之二是社交机器人账户。2016年美国大选之后,假新闻成为全球社会治理的重要议题。本文先从技术路径出发探讨通过算法治理社交平台假新闻的行动逻辑,之后探讨“算法-利益相关者”的假新闻协同治理模式,探索治理社交平台假新闻的新的可行路径。......

2023-11-08

依照人对算法的依赖程度和算法的自主性,算法治理可以分为三类:借助算法治理(governance through algorithms)、依赖算法治理(governance by algorithms)、利用算法治理(governance with algorithms)。“借助算法治理”是用算法加强既有权力关系的治理方式,“依赖算法治理”是算法更自动化、更独立自主的治理方式,“利用算法进行治理”介于两者之间。[38]

目前,完全依赖算法进行治理假新闻的技术手段并未出现,对于一些简单的识别任务,可以采用借助算法治理,这是一种机械的、简单的治理方式。更多的情况是需要“算法+人工”,即在治理中需要人工进行决策。如前文所说的假新闻识别,只要准确率不是100%,都需要人工去进行复核。算法治理三层次在内外部算法中的应用情况如表2所示。

表2 算法治理三层次在内外部算法中的应用情况

在复杂的人类社会中,如果就技术谈技术,技术在治理中发挥的效能有限。社交平台假新闻治理是一个持续的、动态的、复杂的治理过程,参与主体不应只局限于政府和社交平台,而是整个利益相关者(stakeholders)构织的网络,在治理模式上应当摒弃“政府-社交平台”的二元治理模式,采用协同治理(collaborative governance)模式。

协同治理为了解决复杂的公共问题,促使跨域、跨界、跨部门的利益相关者形成伙伴关系,以平等协商的方式参与公共决策制定的制度安排。[39]利益相关者是指任何能够影响企业目标的实现,或受企业目标的实现所影响的个人或群体。[40]以社交平台假新闻治理为中心,利益相关者涉及社交平台、政府、入驻社交平台的新闻媒体、用户和科研共同体。在美国等国家,非政府组织发展成熟、比较活跃,积极参与假新闻治理,也是利益相关者。

算法不是万能的,只依靠算法解决假新闻的治理是偏颇的,但算法又是高效的,其监测、识别假新闻是批量的、自动化的。基于前文的讨论,笔者提出“算法-利益相关者”的社交平台假新闻协同治理模式,强调算法和利益相关者的协作关系。

当然,需要指出的是,假新闻层出不穷,不仅与假新闻的文本本身有关,也与社交平台传播逻辑、社会大环境等有关。因此,本文提出的协同治理模式主要还是围绕算法展开的有关治理体系的讨论,主要目的在于探讨利用算法治理假新闻的思路。

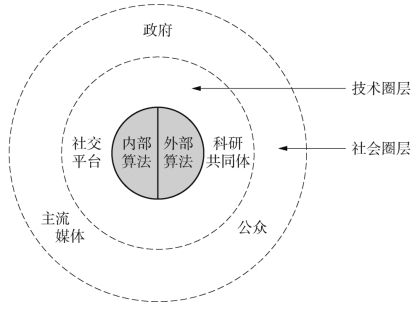

在整个协同治理体系中,依照算法与其他利益相关者的关系,我们可以分为两个圈层:技术圈层和社会圈层(见图1)。技术圈层的利益相关者包括社交平台和科研共同体,重在处理技术上的治理问题;社会圈层的利益相关者包括政府、主流媒体和公众,重在弥补算法治理手段的不足。圈层内部、圈层间,不同利益相关者之间有或强或弱的单、双向关系,为了论述方便,本文重在讨论治理中较为重要的问题。

图1 社交平台假新闻算法治理的圈层

1.技术圈层的协同治理

技术圈层的利益相关者主要是社交平台和科研共同体,社交平台是整个治理体系中除政府之外的另一强势利益相关者。技术圈层的协同治理成效如何,很大程度上取决于社交平台的态度。

当前技术圈层存在的最大问题在于社交平台提供的研究数据不充分,导致科研共同体对某些问题研究的可信度和水平存在局限,无法为社交平台提供很好的智力支持。虽然一些社交平台都有应用程序接口(API),提供部分平台数据,但这些数据只能在一定程度上回答某些问题,由于数据质量的问题,一些研究得出的结论也是比较表象的,无法触及社交平台假新闻传播规律的深层规律。而平台的理由也很简单:涉及商业机密。在研发中,社交平台应积极与外部的科研人员合作,并采取适当的合作方式,将外部的科研成果转化为平台治理的一部分。

社交平台应当意识到信任,而非信息,是当今世界的稀缺资源。[41]调查显示,全球仅有41%的用户信任社交媒体。[42]社交平台需要意识到高质量内容的稀释与缺乏将会是平台生存发展的最大危机。在“连接”的大潮中,有一股“反连接”的逆流,本质上是对社交平台的逃避,其中,不信任是主要原因之一。

与此同时,假新闻的生产与传播日益智能化,“道高一尺魔高一丈”,单纯依靠社交平台的技术“破解”假新闻的生成与传播规律是不现实的。以治理“深度造假”为例,任何深度伪造检测器都只能有效一小段时间。[43]对于社交平台而言,要想从算法技术上治理假新闻,需要引入外部资源,其中来自高校和科研院所的以假新闻研究为旨趣的科研共同体是可以合作的重要利益相关者。

实际上,社交平台的外部已经有很多科研团体在研发与社交平台假新闻的各种技术。波兰初创企业Userfeeds运用区块链技术,创造了一个公开透明的、能被公众审查的新闻内容平台及其配套的排名算法。这种模式能够从根源上实现新闻生产和传播的过程完全透明且可追溯,促使新闻生产者和传播者对真实性负责。[44]

现在,一些社交平台或平台媒体,也在开放合作商进行了有益的尝试。脸书从全球11个国家30个机构挑选出60多名研究人员,他们有权访问经过处理的部分隐私数据,以推动关于社交媒体在选举中作用的研究。[45]2018年1月,今日头条召开算法分享大会,公布了今日头条推荐算法的基本原理。与会嘉宾以阿里巴巴、腾讯、百度、美团、新浪、网易等主流科技公司的算法工程师和产品经理为主。今日头条方面称,算法原则上是机密。[46]

2.社会圈层的协同治理(www.chuimin.cn)

社会圈层的利益相关者主要是政府、主流媒体和公众。

1)政府:改变职能定位,由监管者变为协调者

调查发现,60%的欧洲用户和63%的亚洲用户倾向于让政府直接介入假新闻治理,美国用户仅有41%赞同这一观点。[47]这体现出不同国家和地区用户对于政府在假新闻治理中的角色和作用的不同认识。中国对互联网假新闻治理主要采取自上而下的治理模式,政府和平台是主要的行动者。治理的逻辑是:发现问题—整改约谈—再发现问题—再整改。这种方式能够在一定阶段、一定程度上改善或解决某些问题,但事后监管最大的弊端在于当政府发现问题时,平台存在的问题往往比较严重,较大的社会负面影响已经产生,有的甚至是重大刑事案件。

既然政府的监管能力是有限的,引入协同治理对政府而言可以有效整合社会资源,集不同利益相关者之力展开治理。当然,政府在协同治理中仍处于中心位置,但不是唯一的责任主体,参与治理的利益相关者之间为了实现共同的目标有积极的互动,包括信息、资源、优势的共享,议题和解决方案的协商,方案实施时的分工合作等。[39]这也意味着政府在治理中的角色转换:由监管者转向协调者。

之所以强调政府的协调者角色,主要原因在于不同利益相关者在协同治理体系中的地位、作用、资本、责任等是不同的。强势利益相关者会在治理中主导进程,其他利益相关者与之的合作可能会沦为形式。在社交平台假新闻治理中,社交平台就属于强势利益相关者:它以商业机密为由,不公开算法原理;它以保护用户隐私为由,不提供研究的原始数据……《打击假新闻的研究议程与行动方针》(Combating Fake News:An Agenda for Research and Action)认为,需要给社交平台公司施加压力以分享重要数据。[48]对于这些问题,在所有的利益相关者中,只有政府有足够的能力“倒逼”社交平台采取措施,也只有政府能够最大限度地动员各利益相关者以多种形式、多种机制参与其中。

2)主流媒体:做好真相放大器,改善传播生态

本文在利益相关者中强调主流媒体,而非媒体,很重要的原因在于主流媒体是社会共享价值观重要的凝聚者、社会监测的“信托者”,同时也是假新闻的受冲击者。社交平台不具备界定真假新闻的正当性,作为职业生产内容(Occupationally Generated Content,OGC)的行动者,主流媒体很大程度上承担着事实界定、真相发掘的职能。主流媒体应在整个信息传播系统中承担重要的社会责任。通过专业、规范、严谨的新闻生产规程生产新闻,建立与用户的信任关系,成为用户所信赖的信源。反观现实,一些假新闻其实是主流媒体生产的。

《2018年数字新闻调查报告》(Reuters Institute Digital News Report 2018)的调查数据显示,75%的被调查者认为责任方应该是新闻机构,而71%认为是互联网平台,主流媒体的报道有偏见或不准确。[47]美国社交平台假新闻泛滥的一个主要原因在于美国新闻业的可信度低,导致公众没有值得信赖的消息源,只能相信自己所相信的,这也是后真相的典型表现。爱德曼国际公关公司(Edelman Public Relations Worldwide)发布的“2019年全球信任度晴雨表”显示,中国公众对媒体的信任度最高,达到76%。[49]在中国的语境下,主流媒体可以在治理中大有作为。

主流媒体在日常社交平台传播中的作用是高质量内容的提供者和关键时刻的“真相放大器”。做好负责任的专业报道需要靠主流媒体日常的积累,不断提升公信力,而非关键时刻发声,否则在关键时刻公众也不会相信主流媒体所言。

当主流媒体成为社会可靠的消息来源时,即便有假新闻,公众也拥有可依赖、可相信的信源,而非不知所措。目前,国内外一些社交媒体已经与主流媒体展开合作。脸书已与《华盛顿邮报》、彭博社等多家新闻机构接洽,希望每年向它们支付300万美元的费用,获得新闻文章的授权。[49]2019年,脸书推出“新闻标签”功能,让可靠来源的新闻在平台上获得高度突出的位置。[50]微博在热点事件传播中,对3万多个媒体账号、17万个政务账号的内容优先放大、推送。[51]

3)用户:激活个体参与,多渠道、多方式贡献“微力”

在协同治理模式中,用户扮演了多重角色:①传播者:用户在假新闻传播中起到“推手”的作用。②被影响者:用户同时也是假新闻的“受害者”。③治理的参与者:一些用户是假新闻治理的积极参与者,比如举报假新闻等。一个用户可能会同时负载多个角色。

在社交平台上,用户的力量看似微小,但每一个人都是传播的节点,尤其在封闭的社交空间中(如微信),作为节点的个体在传播中的可信度、影响力和深度不容小觑。如何激活个体的力量,是政府、社交平台、用户等需要考虑的重要问题。

互联网重新塑造了公众的权利意识,个体被赋能、激活,他们不甘于做被动的“接受者”“聆听者”,而希望在公共事务中自由表达和参与行动。[52]在自组织的路径中,一些用户在假新闻专业知识上、社会责任感上比普通用户要高,这部分人会自发、自觉地参与假新闻治理,比如新闻媒体人在朋友圈中看到假新闻后,可能会自觉地核实查验,在转发时进行澄清。还有的用户会利用社交平台提供的“举报”功能,对失实内容进行举报。或许还可能有用户自己组成虚拟社群,线上打假。当然,还有简单、有效的“不转发”,以此降低假新闻被推荐的概率。

对于更多的用户,应当采用他组织的方式:

第一种措施为社交平台组织特定的用户参与假新闻的识别与监测。微博在治理涉黄低俗信息中采用了监督员模式,招募了2 000名监督员。相较于涉黄低俗信息,假新闻的辨识更难,也需要依赖更专业的知识和背景信息。社交平台在组织时应当进行业务培训。

第二种措施为社交平台提供用户协作“打假”的“基础设施”。这种协作打假的方式可以借鉴维基百科的模式,为用户提供一个有关假新闻的数据库,便于核查、追溯和识别。

第三个措施为平台和网络意见领袖建立某种合作机制(在技术、经济和社会效益上)。在假新闻传播中,社交机器人很重要的一个方法是通过“@名人”拉高文章的热度,在假新闻治理中,对于辟谣文章的处理其实也可以采用这种方式。

社交平台正越来越成为人们接触新闻的渠道、想象世界的方式和建构价值观的来源。在散布假新闻的账户中,三分之一到三分之二是社交机器人账户。2016年美国大选之后,假新闻成为全球社会治理的重要议题。本文先从技术路径出发探讨通过算法治理社交平台假新闻的行动逻辑,之后探讨“算法-利益相关者”的假新闻协同治理模式,探索治理社交平台假新闻的新的可行路径。......

2023-11-08

利用算法治理假新闻,如果以社交平台为中心,可以分为内外两种算法治理。内部算法治理是指利用社交平台内部算法的优化,减少假新闻的扩散概率和程度,涉及社交平台推荐算法的“元治理”;外部算法治理是利用社交平台之外的算法对社交平台中的假新闻进行预测、识别。10个网站的假新闻占了调查样本比重的六成,50个网站的假新闻占了近九成。......

2023-11-08

表1社交平台假新闻的算法治理1.分享的“马太效应”:平台逻辑变相鼓励假新闻社交平台假新闻泛滥,不在于制造假新闻的算法多么高明,而在于假新闻的传播逻辑契合了社交平台的算法逻辑和商业逻辑。换言之,社交平台喜欢有分享潜力的文章。在社交平台上,新闻必须是可分享的,新闻越激进,社交媒体上的分享就越多。2018年8月,脸书表示将禁止经常分享假新闻,且禁止反复违规的公司在其平台投放广告。......

2023-11-08

确定型利益相关者对公司有法律上、道义上的索取权,在企业的决策方面有足够影响,对企业的要求能够立即引起企业管理层的关注;关键型利益相关者只能在上述两个方面产生影响;或有型利益相关者只能在上述一个方面产生影响。......

2023-10-15

这是著作权人的专有权利,必须先取得相应的授权。况且,周某并非唯一受害者。作为学位论文的著作权人,学生还有分享研究成果、扩大学术影响、预防剽窃以及获得适当经济利益的要求。因而,学校应当注意检查著作权人的授权意愿和公开时间。......

2023-11-27

利益相关者理论要求企业管理层在经营决策中妥善处理与不同利益相关者的关系,平衡他们正当的权益要求,抵制他们的非分要求,争取利益相关者最大程度的合作,以便实现企业的战略目标。近年来,某些知名景区破坏性的开发就是旅游景区投资商追求经济利益最大化的有利佐证。......

2023-11-20

IR利益相关者模型的10组关系中,国内有4组关系几乎是缺失的,现有的6组关系中也存在很多问题。表7.3国内IR利益相关者现状7.2.2.1IR直接利益相关者与IR直接相关的5组关系中,机构的主导作用比较突出。随着IR的发展,个体机构的集体权利管理诉求有可能上升到教育科研机构和出版机构的集团利益协商层面。......

2023-11-27

相关推荐