社交平台正越来越成为人们接触新闻的渠道、想象世界的方式和建构价值观的来源。在散布假新闻的账户中,三分之一到三分之二是社交机器人账户。2016年美国大选之后,假新闻成为全球社会治理的重要议题。本文先从技术路径出发探讨通过算法治理社交平台假新闻的行动逻辑,之后探讨“算法-利益相关者”的假新闻协同治理模式,探索治理社交平台假新闻的新的可行路径。......

2023-11-08

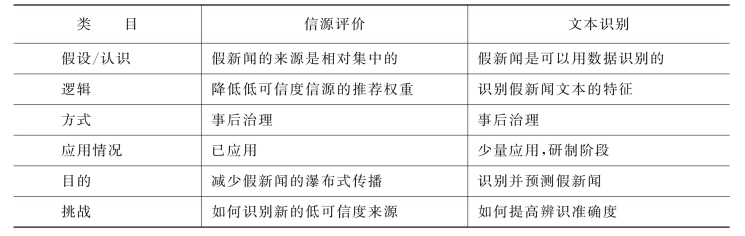

社交平台假新闻的两个算法治理逻辑各不相同(见表1)。斯坦福大学、纽约大学和微软研究院的研究表明,自2016年美国大选到2018年7月,脸书用户的假新闻参与度下降超过了50%。[30]用算法治理假新闻会有一定效果。技术不是完美的人工物,用技术治理技术问题同样存在短期内难以克服的局限。

表1 社交平台假新闻的算法治理

1.分享的“马太效应”:平台逻辑变相鼓励假新闻

社交平台假新闻泛滥,不在于制造假新闻的算法多么高明,而在于假新闻的传播逻辑契合了社交平台的算法逻辑和商业逻辑。社交平台的算法推荐逻辑强调社交关系、分享、点击和相关性。如脸书强调信息与用户之间的相关性与适用性。[31]这种算法逻辑会导致流量的“马太效应”:越有吸引力的文章分享越多,越多的分享带来越多的流量,分享和流量到一定程度就会完成文章的冷启动,进而快速进入推荐系统,带来更多分享和流量。没有吸引力的内容,算法系统不仅降低推荐概率,甚至连冷启动阶段都完成不了。只要假新闻有足够的吸引力,在社交平台进行病毒式传播是早晚的事。平台开发者最初考虑的主要是传播速度和广度,在事实辨别方面存在设计漏洞。[32]因此,社交平台假新闻屡禁不止的关键原因在于假新闻的传播与算法设计中的激励机制相一致。[33]研究显示,推特上的假新闻比真新闻传播快,链条也更深深:1%的假新闻会到达1 000~100 000人,而真新闻很少能达到1 000人。[18]换而言之,无论社交平台的算法如何调整,都只能从一定程度上改善以“分享” 为核心的算法推荐逻辑。

商业逻辑是流量与广告费成正比,广告商为每次的点击付费,社交平台与账号用户(网站)分成。换言之,社交平台喜欢有分享潜力的文章。于是一些人大肆制造假新闻,他们不关心党派之争,关心的是流量和变现。一些社交平台宣称自己不是“媒体”,而是“平台”,抽身于内容监管之外,让商业利益最大化。脸书前产品管理副总裁萨姆·莱辛(Sam Lessin)曾说:“为了获得市场份额,你需要激进,理性不会帮你得分。”在社交平台上,新闻必须是可分享的,新闻越激进,社交媒体上的分享就越多。[34]

在巨大的舆论压力之下,谷歌和脸书终于相继推出了断绝假新闻“财路”的措施。2016年11月,谷歌禁止假新闻网站使用其广告服务。2018年8月,脸书表示将禁止经常分享假新闻,且禁止反复违规的公司在其平台投放广告。由此看出,对于社交平台的这种逻辑“缺陷”,一些平台希望借用经济的方式治理以商业性为目的的假新闻生产与传播,但对以政治利益或其他非商业利益的假新闻,经济手段是无效的。(www.chuimin.cn)

2.算法不会思维:真假新闻微妙界限难辨别

当前人工智能还处于弱人工智能(Artificial Narrow Intelligence,ANI)阶段,只能处理特定任务,没有独立的意识。这一阶段将持续相当长一段时间。假新闻文本的内容是复杂的,需要依靠专业知识、社会经验、话题语境、语义理解等多方面的技能才能拥有极高的辨识准确度。弱人工智能显然达到不这一层面。

首先,不是所有的指标都可以“数据化”。例如,“误导性”如何编码?人类难以界定,人工智能想理解这一点,还有很长的路要走。[35]

其次,算法是无法理解人类语言和知识的。人类的语言是微妙的,由于算法无法理解语言,所以在算法中,分类常基于语言模式和其他简单信号,这可能会让算法将真、假新闻一并归类。[36]此外,算法也无法理解人类知识。当算法面对宗教、哲学等抽象知识时,无法像人类一样会意,或辨识其可信度。[22]

最后,假新闻的特征千变万化,对其模式特征的识别也需要因应变化。只要假新闻在原来的基础上发生一些改变,原识别算法的适用性就成为问题。例如,用写作风格作为识别手段的算法被广泛采用,造假者也会适当改变写作手法以蒙混过关。[22]

虽然研究显示算法比人类鉴定者更准确、更有效,但24%的失败率表明人类仍在捕捉恶作剧故事中发挥重要作用。[24]假新闻打击平台“假新闻挑战”(Fake News Challenge)认为:除非我们已经拥有达到了人类水平的AI,能够理解微妙而复杂的人际互动,并进行调查性新闻报道,那时才有可能自动核查。[37]

社交平台正越来越成为人们接触新闻的渠道、想象世界的方式和建构价值观的来源。在散布假新闻的账户中,三分之一到三分之二是社交机器人账户。2016年美国大选之后,假新闻成为全球社会治理的重要议题。本文先从技术路径出发探讨通过算法治理社交平台假新闻的行动逻辑,之后探讨“算法-利益相关者”的假新闻协同治理模式,探索治理社交平台假新闻的新的可行路径。......

2023-11-08

利用算法治理假新闻,如果以社交平台为中心,可以分为内外两种算法治理。内部算法治理是指利用社交平台内部算法的优化,减少假新闻的扩散概率和程度,涉及社交平台推荐算法的“元治理”;外部算法治理是利用社交平台之外的算法对社交平台中的假新闻进行预测、识别。10个网站的假新闻占了调查样本比重的六成,50个网站的假新闻占了近九成。......

2023-11-08

协同治理为了解决复杂的公共问题,促使跨域、跨界、跨部门的利益相关者形成伙伴关系,以平等协商的方式参与公共决策制定的制度安排。基于前文的讨论,笔者提出“算法-利益相关者”的社交平台假新闻协同治理模式,强调算法和利益相关者的协作关系。图1社交平台假新闻算法治理的圈层1.技术圈层的协同治理技术圈层的利益相关者主要是社交平台和科研共同体,社交平台是整个治理体系中除政府之外的另一强势利益相关者。......

2023-11-08

5.6.3本研究的局限性一方面,本研究的数据在时间上,是通过近两个月的调查获得的,数据的时间性只是局限于那一刻,但是家族企业代际传承是一个长期的过程研究,还需要以后的跟踪调查;在数量上由于调查的范围局限在温州大学城的几所高校,对于没有接受高等教育或者已经毕业的家族企业主子女等对象没有进行调查,所以调查的对象以及数量上还是做得不够的。......

2023-11-27

郑国将有诸侯之事,子产乃问四国之为于子羽,且使多为辞令。而告冯简子,使断之。事成,乃授子大叔使行之,以应对宾客。郑人游于乡校⑤,以论执政。译文子产从政,选择有才能的人分别加以使用。子产和裨谌乘车到野外,让他考虑这次行动是否可行。然后把考虑的结果告诉冯简子,让他作出决断。子产这样做,很少有把事情办坏的时候。子产因此能够把郑国治理得很好。......

2023-09-22

2011年是微信求生之年,一年之内连续推出三个版本:1月推出1.0版,定位于手机端文字通信工具;5月推出2.0版本,开始向多媒体通信工具发展;10月推出3.0版,朝着强调陌生人交友方向发展;2012年4月,4.0版时推出,标志着微信正式转型为手机社交平台。后面通了电话、加了微信,联系主要通过微信或者打电话了。......

2023-11-25

随着大数据的发展与广泛应用,数据化运营成为抖音等众多短视频平台进行内容分发的新模式,平台的运营更加精准化。[9]浙江传媒学院的李墨涵认为抖音平台通过对短视频内容进行智能分发、叠加推荐等方式精准地抓住用户的注意力,其视频流主要依赖算法推荐机制,但对于算法的依赖会导致信息蚕房效应、同质化等一系列问题。[10]李墨涵:《抖音算法推荐机制的局限与对策分析》,载《新媒体研究》2019年第2期,第28~29页。......

2023-11-09

网络社交平台的出现,首先实现了和电话一样的实时通信功能,但是很快人们发现在这个平台上,娱乐性质的聊天,有时比实用性质的信息传达更具有普遍性。今天,网络社交平台显示其已经成为人们重要的社交娱乐场所,它让原本充满乐趣的“聊天”获得了一个前所未有的传播媒介。这里需要说明一点,是网络社交平台上的“聊天”与广播媒介的“脱口秀”有着本质的不同。网络社交平台上“聊天”的乐趣在哪里?......

2023-11-03

相关推荐