标记图是一种一维函数的边界表达方法,其典型的生成方法是将从质心到边界线的距离转化成一个角度函数,如图7-8所示。本书提出的角点标记图将标记图的基本思想应用于构造角点特征的过程中,并在保存目标基本信息的同时消除其对尺寸和旋转的依赖性,使得该特征具有平移不变形、比例不变性和旋转不变性。这种模式向量的生成方法依赖于旋转和比例缩放变换。......

2023-06-28

1.实验环境

(1)硬件环境

普通DELL台式计算机一台,基本配置为P(R)D/3.4GHz/1.00G/160G/19in[1]。

(2)软件环境

WindowsXP操作系统,Visual Studio C++6.0开发平台,OpenCV函数库。

2.实验数据来源

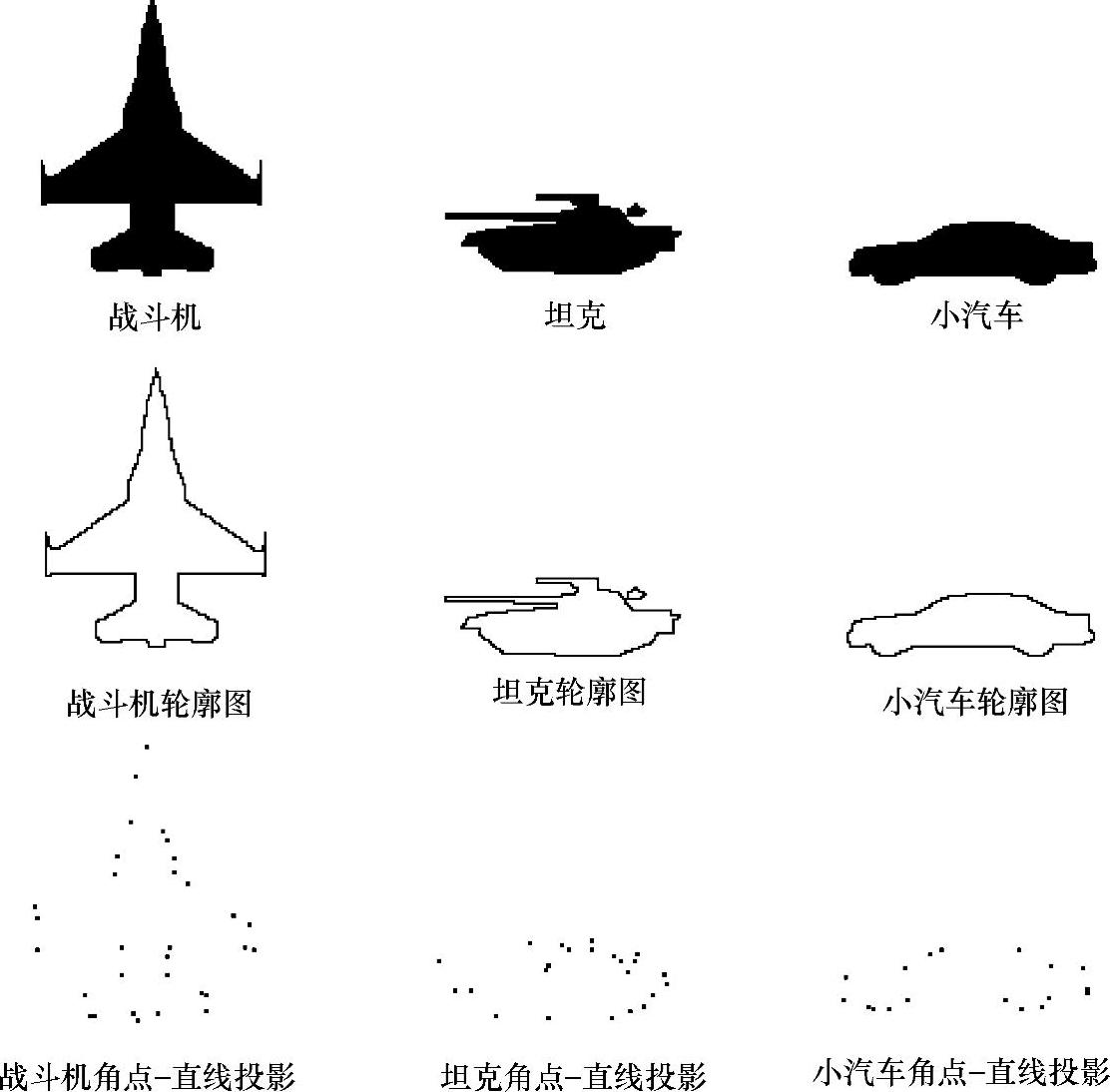

Caltech101图像库共有101类目标,每类目标有40~800幅图像,图像大小为300×200像素;普林斯顿大学三维模型库(Princeton Shape Benchmark)[2]中的模型可以投影为2D图像,模拟相应物体分割后的二维灰度图像。我们从普林斯顿模型库中挑选出一个飞机模型F16、一个坦克模型T60、一辆汽车模型用来进行与角点检测相关的实验。

图4-9 图像局部特征的提取与表示

a)建筑物与人 b)汽车与树 c)建筑物与人的特征点 d)汽车与树的特征点 e)建筑物与人的特征描述 f)汽车与树的特征描述

实验1:DoG特征点检测与SIFT特征描述子表示

如图4-9c和4.9d所示,DoG检测算子是稀疏选取法的典型代表,其检测出的特征区域数量一般在200~3000个,其主要优点是简洁、紧致,图像的特征点远远少于图像的像素,使得后面的识别过程能大大加速。但很多特征区域检测算法往往和图像的特性相关,应用到通用目标识别时,可能会有一定的局限。图4-9e和4-9f为SIFT描述子的向量表示方式,箭头的起点代表该特征点的位置,箭头的长度代表该特征点所处的尺度,箭头的方向代表该特征点的主方向。

实验2:直线投影和SUSAN角点检测

如图4-10所示,直线投影法相对来说简单实用,具有较高的检测精度和稳定性,由于把角点定义在目标的轮廓线上,必须先分割图像并进行二值化,这样一来对前期的图像分割有很大的依赖性,而图像分割本身运算比较复杂,分割过程中出现的任何错误都有可能影响到检测结果。SUSAN算法则不需计算梯度,不需插值且不依赖于前期图像分割的结果,直接对像素的邻域灰度值比较即可检测出角点,速度比较快,通过自适应阈值的改进之后,该算法的抗噪声干扰能力有所加强,角点检测效果比较理想。

图4-10 二值图像的角点检测效果

图4-10 二值图像的角点检测效果(续)

有关图像目标的表示与识别的文章

标记图是一种一维函数的边界表达方法,其典型的生成方法是将从质心到边界线的距离转化成一个角度函数,如图7-8所示。本书提出的角点标记图将标记图的基本思想应用于构造角点特征的过程中,并在保存目标基本信息的同时消除其对尺寸和旋转的依赖性,使得该特征具有平移不变形、比例不变性和旋转不变性。这种模式向量的生成方法依赖于旋转和比例缩放变换。......

2023-06-28

s是复数变量,在s平面上可表示为s=σ+jω。不失一般性,取s平面上F的零点、极点及闭合路径,如图5-34所示。图5-34辐角定理示意图当s沿ΓS绕行时,∠和∠将随之变化。由式得式中,为F所有零点辐角之和;为F所有极点幅角之和。假设F在Γs之内有Z个零点和P个极点,当s沿Γs顺时针方向绕行一圈时,F的相角变化为相角变化-2π相当于ΓF按顺时针方向包围F平面的坐标原点一圈。......

2023-06-28

由于SUSAN算法不依赖于目标分割得到的轮廓信息,所以无法通过跟踪轮廓来得到角点的顺序,并依此计算每个角点的权重,进行特征空间的优化。两种角点检测算法及其相应的特征空间优化方法的效果,如图7-7所示。图7-7 对角点特征空间进行优化设计~e)是进行特征选择,g)~i)是进行特征的组合优化)......

2023-06-28

如果把少量石灰和陈醋混在一起,你会发现醋的酸味很快消失了。凡是腐烂的植物,无论树叶、苔藓,还是芦苇、老树干,都会产生一种有一点儿苦味的物质,我们称之为“酸”。酸对植物的生长非常不利。最明显的例子是沼泽地,那里含有的酸性物质就是过量的,非常不适于种植各类农作物,只有无用的芦苇和莎草艰难地生长。石灰恰好能改善这种酸性环境,能在沼泽和潮湿的草甸上创造奇迹。......

2023-10-21

这一准则放在角部依然适用,白1、白3扳粘是要点,黑4打吃是问题手,白5立下,黑6只能长出,白7吃掉两子。图四黑1接住是失误的下法,这步棋错失了对杀的关键。图五黑1二路立,这是事关生死的要点!本图黑棋角上有4口气,不仅留下了劫材,黑6拐头之后,将来留有诸多借用。图十三黑棋不甘心被吃,走1位抵抗,白2外扳,黑棋气紧的弱点暴露无遗。......

2023-10-30

甘松性凉、轻,在兽医临床中多用于治疗“热毒泻”“瘟疫症”,其在抗菌消炎、治疗消化系统疾病和传染性疾病方面都有作用。以甘松、草乌叶、瞿麦、多叶棘豆等药材制成巴布-7蒙药复方,可压制疼痛,除热止痢,有效杀灭致犊牛腹泻的大肠杆菌[44]。以甘松和银朱各一钱半,冰片、甘草、白芍各一钱,诃子、草乌叶各五钱,病猪温水灌服,连续3日可清热解毒、涩肠止泻[47]。家畜误食霉草中毒,排黑色粪便。......

2023-11-23

在轴承实际使用中,如果作用于轴承上的载荷小于上述各公式估算出的Frmin或Famin,则为了防止轻载打滑,必须对轴承进行预紧。表2-63 最小轴向载荷系数Ka[1]通过滚动体中心与轴承轴线垂直的平面称为轴承的径向平面。包含轴承中心线的平面称为轴向平面。[3]式中对点接触所以取ε=3而对线接触:,,ε=4但是因为滚子轴承的接触形式很多,既有点接触,又有线接触,为统一滚子轴承的寿命计算方法,取ε=。......

2023-06-26

对多维距离向量这种最具代表性的角点描述方法进行深入分析后,不难发现,数量繁多的角点不仅增加了运算时间,同时也给多帧图像中的目标匹配带来了困难,尤其是有噪声干扰和在目标姿态变化的情况之下。通过重心点G和P1可以得到飞机的一条基准轴线,显然,飞机两翼上的角点都位于这条轴线的两侧。......

2023-06-28

相关推荐