在所有可能的项集中,有很多候选都不是频繁的。算法4.2Apriori算法伪代码FPGrowth方法使用一种增强的前缀树对数据D进行索引,以实现快速的支持度计算。FPGrowth将所有的项按照支持度的降序排列。FP树构建完成后,所有的频繁项集就可以从树中挖掘出来。基于频繁树模式的频繁集搜索方法见算法4.3。算法4.3FPGrowth算法伪代码......

2025-09-29

聚类分析发现强相关的对象组,而特异检测发现不与其他对象强相关的对象。因此,聚类在一定程度上可以用于特异检测[97]。

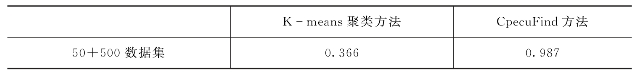

利用聚类来发现特异数据,自然的想法是将小而远离其他簇的簇中数据判定为特异数据。理论上讲,任何聚类技术均可以利用,而且,聚类效果好的算法,发现特异数据的能力好。但这类方法对簇个数的选择很敏感,并且特异因子的得分也很难确定。虽然,把一组对象看做特异数据与将单个为象判定为特异数据在本质上只是从个体扩展到类。如果要评价小簇中对象的特异程度,在聚类后,还应评估对象属于簇的程度。一般可以用对象与簇中心的距离来表示对象属于簇的程度,也可以用对象到簇的质心的相对距离来衡量。相对距离是对象到其簇质心的距离与簇中所有点到质心的距离的中位数之比,其值可以调整松散簇与紧致簇的密度差别。利用第3.3.2节中的数据集50+500,按欧氏距离进行K-means聚类,聚类数设为15。将聚类结果按类的大小从小到大排序,在同一聚类中对象按与类中心距离由大到小排序,得到一序列,希望其可以代表对象的特异程度从大到小的序列。根据对象的真实类别设小类(攻击类)为正类,大类(正常类)为负类,绘制此序列的ROC曲线,其与同数据集的CpecuFind算法的ROC曲线对比如图3.8所示,其曲线下面积的对比如表3.6所示。

图3.8 K-means聚类方法与CpecuFind发现特异数据能力ROC曲线

(a)K-means聚类;(b)CpecuFind(https://www.chuimin.cn)

表3.6 K-means与CpecuFind发现特异数据能力ROC曲线面积对比

上述对比说明,只简单地以簇类大小和对象与类心距离来评估对象的特异程度结果很粗糙,其评价特异数据的能力远不如Cpecu Find方法。

【定义3.1】基于聚类的群点:一个对象是基于聚类的离群点,如果该对象不强属于任何簇。

【定义3.2】(文献[97]中的定义10.8)说明,聚类创建数据的模型,但特异数据会扭曲该模型,直接以聚类结果来表征特异程度不能让人满意。

相关文章

在所有可能的项集中,有很多候选都不是频繁的。算法4.2Apriori算法伪代码FPGrowth方法使用一种增强的前缀树对数据D进行索引,以实现快速的支持度计算。FPGrowth将所有的项按照支持度的降序排列。FP树构建完成后,所有的频繁项集就可以从树中挖掘出来。基于频繁树模式的频繁集搜索方法见算法4.3。算法4.3FPGrowth算法伪代码......

2025-09-29

Apriori算法[3]是单维、单层、布尔关联规则挖掘算法,是最简单形式的关联规则挖掘。该算法是挖掘产生布尔关联规则频繁项目集的经典算法,对关联规则挖掘研究有着重要影响。图2.3Apriori-gen算法Apriori算法调用Apriori-gen,生成所有频繁项集,如图2.4所示。Apriori算法假定数据库驻留在内存中。Apriori算法之后,学者们不断研究其改进算法及其他思想的关联规则挖掘算法,取得了很多成果。图2.4Apriori算法图2.5找出频繁项集L后生成关联规则算法......

2025-09-29

聚类的定义与待处理对象特征有关。聚类的方法很多,不同的方法对于同一数据集聚类的结果可能不同。根据层次分解形式的方式,层次聚类方法可划分为凝聚的层次聚类和分裂的层次聚类方法。绝大多数层次聚类方法属于这一类,它们的不同表现在簇内与簇间相似度的定义不同。目前,一般将基于层次的聚类方法和其他聚类技术进行集成以形成多阶段聚类,从而提高聚类质量。它是一种结构辅助聚类的方法,在大型数据库中的速度和伸缩性较好。......

2025-09-29

分段计算法就是把时间分成一个个小段,在每一个小段时间内,把变加速运动近似地看成是等加速运动来解。为了提高计算精度,我们取时间段初和时间段末的加速度的平均值,作为计算每个时间段速度增量的加速度。图15-5切除故障瞬间的过剩功率图15-6转子摇摆曲线1—稳定;2—不稳定分段计算法的计算精度与所选用的时间段的长短(即步长)有关,Δt太大,固然精度下降;Δt过小,除增加计算量外,也会增加计算过程中的累计误差。......

2025-09-29

在借助数据结构存放中间结果来挖掘关联规则的算法中,FP-growth算法[89]效率较高,其中使用的树结构FP-Tree成为很多研究的基础。通过递归调用FP-growth的方法来直接产生频繁项目集。为方便后面叙述,表2.1中在第3列列出了每个事务中按降序排列的频繁项。第二次扫描数据库并构建FP-Tree。图2.6[例2.1]生成的FP-TreeFP-Tree的构造算法如图2.7所示。FP-growth算法以FP-Tree头表的倒序为计算顺序,从下至上递归搜索FP-Tree,逐步生成所有的频繁项集。图2.7FP-Tree的构造算法图2.8FP-growth算法......

2025-09-29

多分类器融合就是融合多个分类器提供的信息,得到更加精确的分类结果。多数据投票法和BKS方法均是决策层的多分类器融合方法。利用训练集数据学习获得一个分类器,然后使用测试数据集对该分类器分类精度进行评估。......

2025-09-29

对纽约市交通事故进行空间热点分析时,选用聚类和异常值分析法对计算出的结果进行挖掘。H区域为西35大街和36大街在第五大道与第六大道中间的路段,从中午12时至下午5时,此区域为交通事故黑点路段。......

2025-09-29

利用发电机调压时,发电机无功功率输出不应超过允许的限值。当最大负荷和最小负荷两种情况下的电压变化幅度不很大又不要求逆调压时,适当调整普通变压器的分接头一般就可满足要求。上述各种调压措施的具体运用,只是一种粗略的概括。对于实际电力系统的调压问题,需要根据具体的情况对可能采用的措施进行技术经济比较后,才能找出合理的解决方案。......

2025-09-29

相关推荐